寄稿記事

掲載誌:2023年12月8日、日経産業新聞「戦略フォーサイト」

執筆者:EY弁護士法人 アソシエートパートナー 増田 好剛

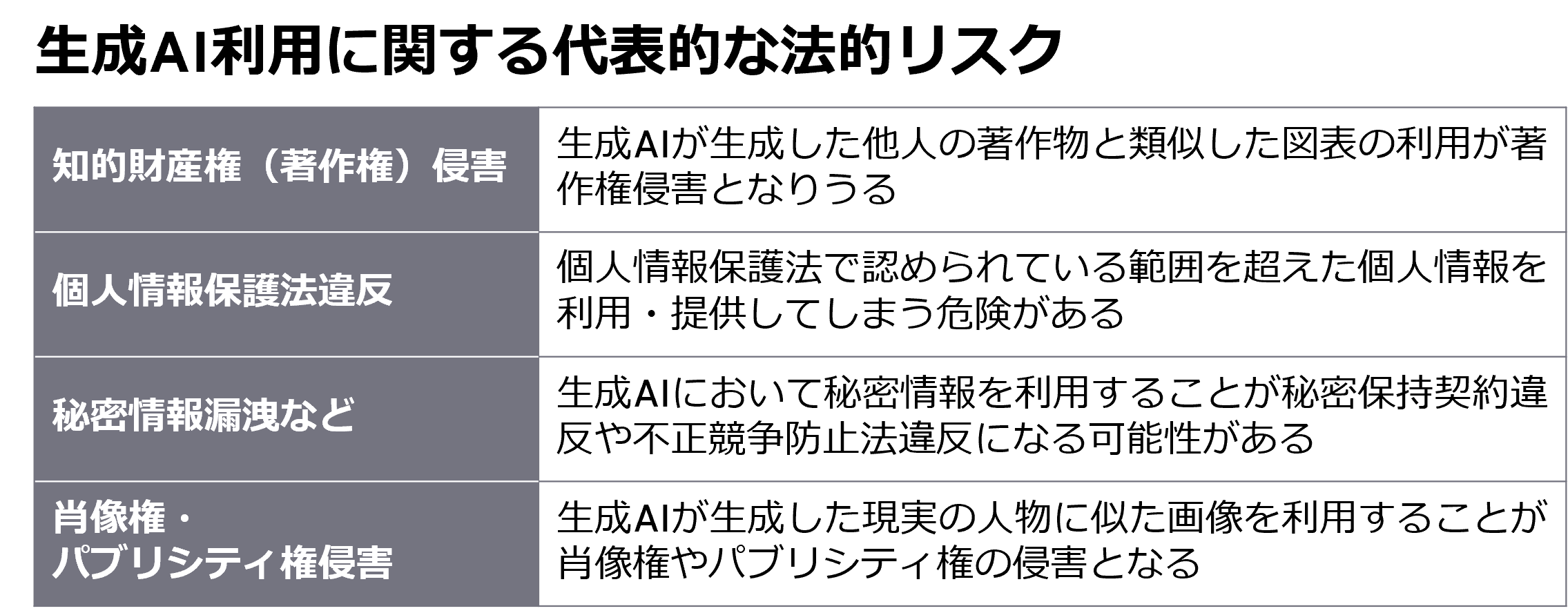

生成AI(人工知能)の利用には様々な法的リスクもある。不適切な利用で法令違反や契約違反に問われる恐れもあり、社内ルールの整備が欠かせない。

知的財産権に関連するリスクでは、特に著作権侵害に留意する必要がある。著作権法は著作権者以外の第三者が著作権者の許諾を得ることなく著作物を利用することを規制している。AIで作成した図表を使用した場合、著作権を侵害する可能性がある。

プライバシー・個人情報保護の観点も重要だ。個人情報保護法は事業者による個人情報の取得・管理・利用・提供について規制しており、事業者は自社が管理する個人情報を法律で認められた範囲内でのみ利用・提供することが求められている。生成AIの不用意な利用は個人情報の目的外利用や違法な提供となる可能性がある。

このほか、秘密情報の漏洩などのリスクや肖像権や「パブリシティー権」(肖像などが有する顧客吸引力の排他的利用権)を侵害してしまうリスクも指摘されている。

こうした法的リスクを回避・低減する方法に「AIガバナンス」の整備がある。AIガバナンスとは、管理体制・ルール・プロセスなど、AIの信頼性や正確性などを担保するため、AIを開発・運用(提供)・利用する際の活動を統制する基本的な考え方及び仕組みを指す。

内容は企業のAI活用状況に応じて異なってくる。単に生成AIをユーザーとして利用する場合と、生成AIを自社システムに組み込む場合では必要とされるレベルが異なるが、企業が事業活動で生成AIを活用する以上、少なくとも生成AI利用のためのガバナンスを整備することが望まれる。

AIガバナンス整備における実務上の主な取り組みとして、生成AI利用に関する社内ルールの策定がある。規定すべき内容については法令上の規定はなく、基本的に各社の判断に委ねられている。

その点、一般社団法人の日本ディープラーニング協会が公表している「生成AI利用ガイドライン」は、企業が自社の社内ルールを作成する際の参考となる。ガイドラインの目的、ガイドラインの対象とする生成AI、生成AIの利用が禁止される用途、ガイドラインの構成、データ入力に際して注意すべき事項、生成物を利用する際の注意すべき事項を規定している。

各企業は、自社の生成AIの活用方法を踏まえ、社内ルールの適用対象となる組織・サービスを特定し、当該サービスの評価、関連する法令・ガイドラインや社内規程を確認しながら社内ルールを作成することが考えられる。

ただし、社内ルールの策定だけでAIガバナンスの整備が完了するわけではない。法的リスクなどを回避するためには、ルール策定後、ルール浸透のための役員・従業員への啓蒙活動に取り組み、AI活用状況の変化に合わせてルール見直しを進める必要がある。

(出典:2023年12月8日 日経産業新聞)